如果你要把一张裁得过紧的人像改成横幅、给商品图补出更多留白,或者把风景图往画面外继续延展,不要直接拉伸图片。正确思路是用 AI 外扩。对大多数“先把比例救回来”的需求,先开 Clipdrop 这类专门的 uncrop 工具就够了。只要原图本身很重要、你又在意主体边缘是否自然,Photoshop Generative Expand 会更稳。若你更想用自然语言去“把场景往外继续写”,ChatGPT Images 是最低摩擦的路线。若你要做批量、自动化、可重复的工作流,那就该看 Vertex AI Imagen 或 OpenAI 的图像 API。

之所以要这样分,是因为大多数“AI 扩图”页面仍把几种完全不同的任务混成一个承诺。它们让人误以为所有工具都在解决同一件事。其实不是。快速补比例、保真优先的照片外扩、创意式场景延展、以及可控的遮罩式生产工作流,本来就是四个不同问题。

下文所有会变化的事实,均已在 2026 年 3 月 27 日 对照官方产品页、帮助文档或 API 文档重新核对。

要点速览

先给最短答案。

| 如果你的真实任务是 | 最该先打开的工具 | 为什么它赢 | 主要代价 |

|---|---|---|---|

| 只是想把同一张图改成更宽或更高的比例,用在社媒、广告或演示里 | Clipdrop Uncrop | 最快的专用改比例工作流 | 适合快速补边,不适合特别严苛的边缘控制 |

| 原图很重要,外扩后必须尽量像原来拍出来的 | Photoshop Generative Expand | 保真优先,且可立即手工修边 | 更慢,而且是付费工作流 |

| 想靠文字不断把场景往外扩、边改边看 | ChatGPT Images | 选区 + 对话的迭代效率高 | 选区并不总是精确,改动可能会溢出 |

| 需要明确遮罩行为,做商品图、背景扩展或自动化 | Vertex AI Imagen | BGSWAP 和 OUTPAINT 区分明确 | 开发接入门槛更高 |

| 想要一个更像创意编辑器而不是硬性合成器的 API | OpenAI 图像 API | 多轮编辑、编辑/生成可控、提示词驱动 | 遮罩更像“引导”,不是绝对硬边界 |

如果你只记住一句话,就记这句:先选那个既够轻量、又能保护住你最在意部分的工作流。

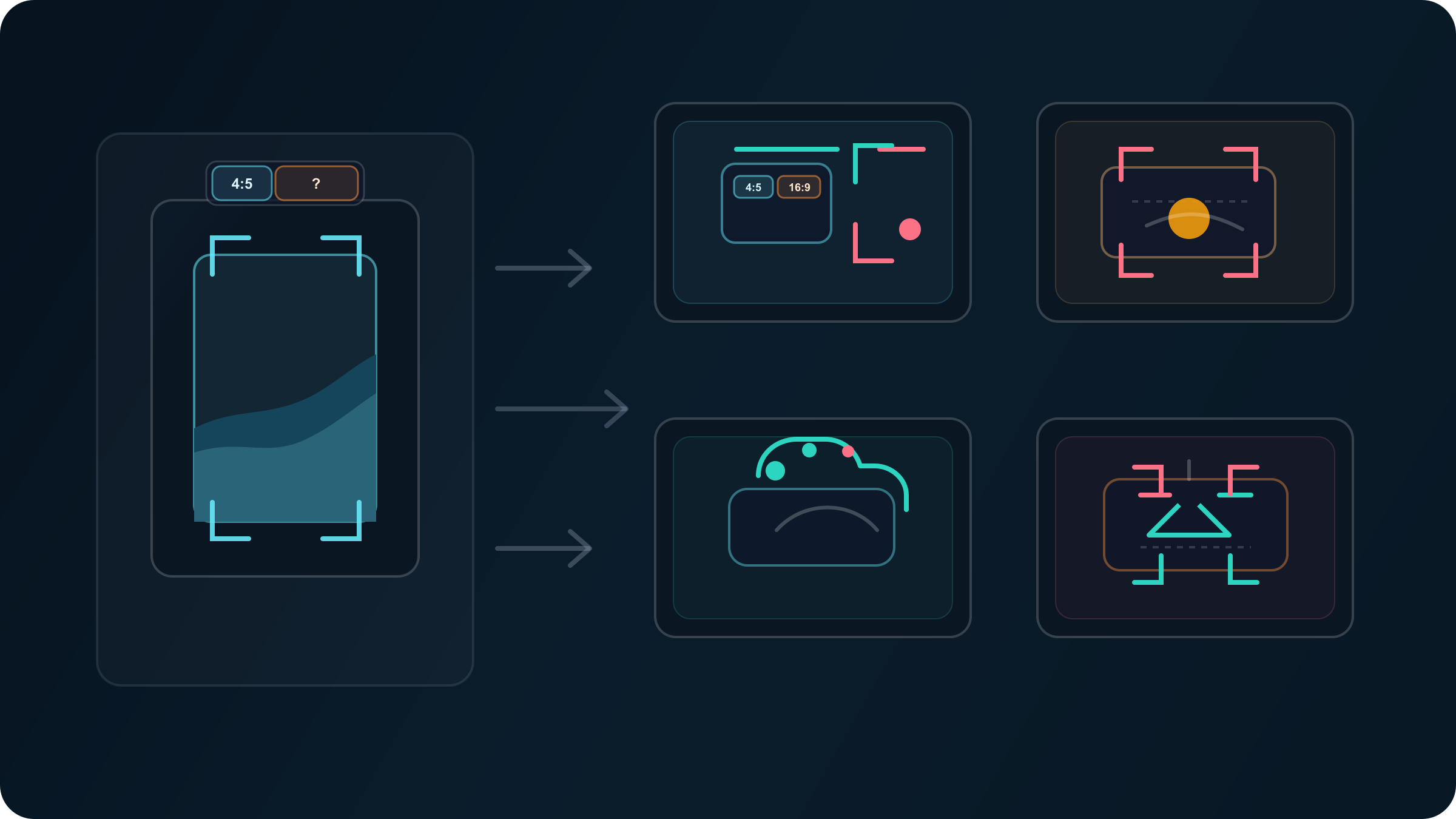

AI 扩图其实不是一个任务

“AI 扩图”这个词听起来很简单,但它至少对应四种不同工作。

第一种是补比例。 图你本来就满意,只是现在需要更宽、更高,或者需要换成另一种画幅,才能塞进网页头图、视频封面或社媒版位里。这类任务最适合专门的 uncrop 工具。你的目标不是重做图片,而是把构图救回来。

第二种是保真优先的照片外扩。 比如人物肩膀贴边了、产品图周围留白不够、建筑线条被截断了。此时你不只是“继续补画面”,还要保护原图不漂移。这时需要更强的编辑器,因为一旦边缘被编错,看起来就会很假。

第三种是创意式场景延展。 这里读者其实希望模型主动想象更多场景。比如把一个人像扩成更宽的摄影棚环境,或者让咖啡馆窗边多出更多桌面和空间。这种任务里,对话式编辑通常比死扣遮罩更快,因为你调的是氛围和空间,不只是像素边缘。

第四种是生产级 outpainting。 当你要批量扩很多图、保护主商品、或者做广告/目录/应用内自动化时,这才是真正的 API 问题。此时你关心的已经不是“哪个图看起来最惊艳”,而是“哪个系统给我的编辑契约最清楚”。

所以,很多工具列表之所以读起来都不够解决问题,不是因为它们漏了几个品牌,而是因为它们把不同任务假装成了同一种任务。真正的错误往往不是“选错品牌”,而是拿快速补边工具去做遮罩工作,或者拿聊天式编辑器去扮演生产合成器。

Clipdrop Uncrop 是最快的在线扩图方式

Clipdrop 的官方 Uncrop 页面直接把它描述成一个“优化用于修改图像宽高比”的工具,流程也非常直接:上传图片、选择新的比例、生成更宽或更高的版本。对大多数只是“比例不对”的用户,这就是最符合直觉的答案。

这个优势不能低估。如果你的原图本来就不错,问题只是画幅不适配,那么专门的 uncrop 工具能省掉大量决策成本。你不用先想遮罩,不用先切换编辑模式,也不用把工作拆成多步。直接补出画框、看结果、继续用。

它尤其适合:

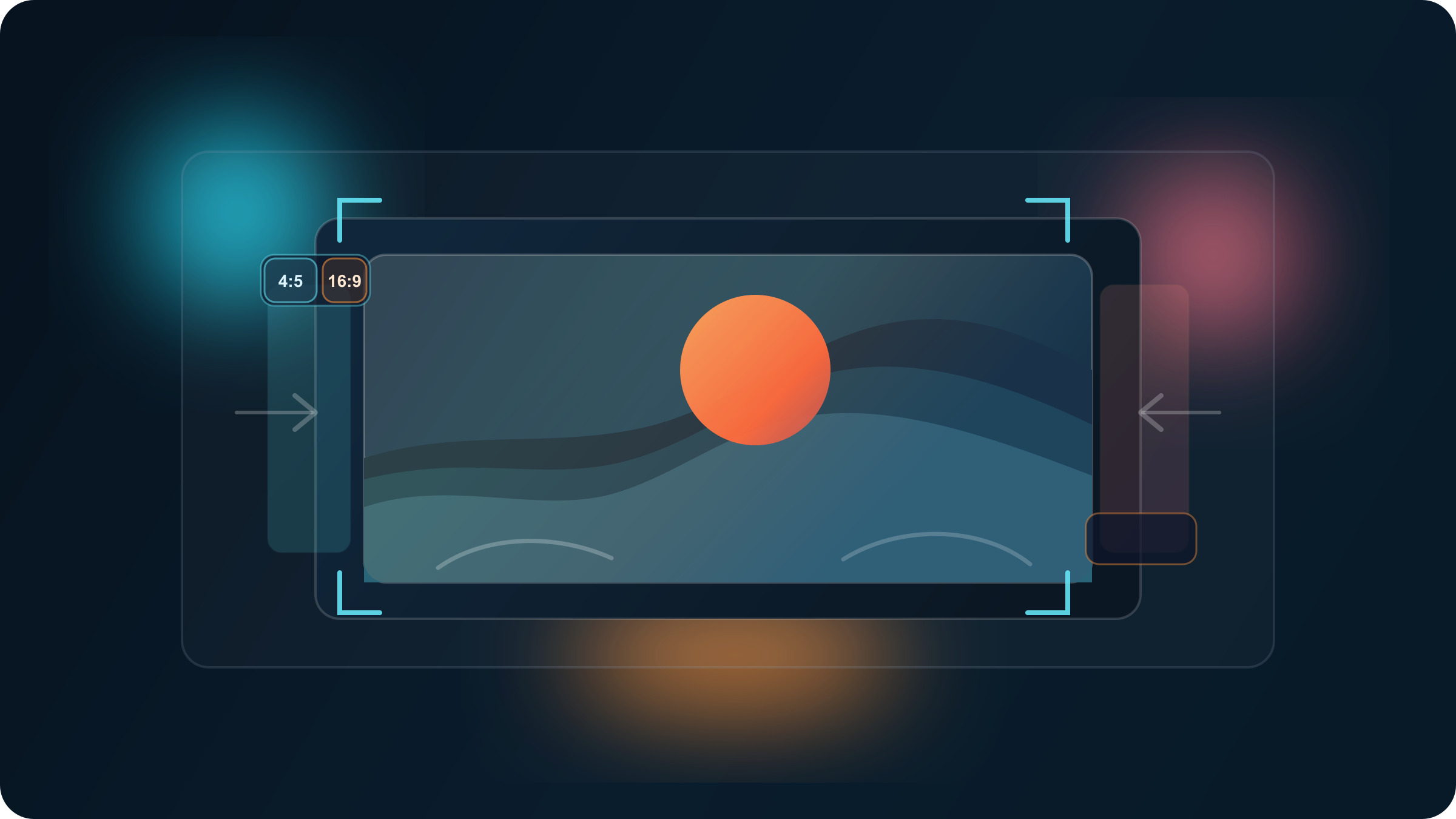

- 把 4:5 的社媒图改成 16:9 横图

- 给风景图补出安全边距

- 给居中主体补一点背景空间,而主体本身并没有被严重裁断

但这类工具一旦遇到“边缘必须很准”的画面就会开始吃力。比如人物手臂正好断在边缘、产品轮廓必须干净、建筑线条必须延续得很直时,一键式 uncrop 很容易生成第一眼看着还行、第二眼就露馅的细节。这不是它做得差,而是任务已经变了。

所以 Clipdrop 这类工具最适合的是构图补救。一旦你的真实目标变成主体保护,就该往上一档。

Photoshop Generative Expand 是原图重要时最稳的默认答案

Adobe 当前的 Photoshop 官方文档把 Generative Expand 的用法说得很明确:先把裁剪框往外拖,扩大画布,再选择 Generative Expand。如果你想让 Photoshop 尽量顺着原图自然补完,可以把提示词留空,直接点 Generate。

这个“先留空再生成”的细节非常关键。因为当你的目标是“延续原图”,而不是“重写一张新图”时,空提示词往往比一大段描述更干净。你实际上是在告诉 Photoshop:“按这张图原本的逻辑继续画下去。” 这和“围绕这张图再编一个新场景”是两种完全不同的指令。

这也是 Photoshop 特别适合以下场景的原因:

- 人像图里发丝、肩膀、衣服边缘不能乱

- 商品图需要更多留白

- 室内、建筑、陈列这类对线条连续性敏感的照片

- 编辑图、媒体图这类必须保住原始摄影感的内容

它相对一键式网页工具的真正优势,不只是“模型强一点”,而是你可以在扩图后立刻修边、补遮罩、微调再裁一刀,而不用换到另一个工具里重新开始。

我的经验很简单:只要这张图本身值得你认真保住,先开 Photoshop。 先用空提示词做连续性外扩,只有当缺失区域确实需要新意图时,再补第二轮更有针对性的提示词。

ChatGPT Images 最适合用文字把场景往外推

OpenAI 的帮助中心现在明确写着,ChatGPT Images 编辑器既支持选区后修改,也支持直接在对话框里描述你要的变更。同时它也明确提醒:高亮选区并不总是精准,修改有可能超出你标记的区域。

这句提醒其实刚好解释了 ChatGPT Images 的最佳使用边界。

它特别适合下面这种需求:

- “把这张人像扩成更宽的摄影棚场景”

- “让咖啡馆窗边再多一点桌面和外部空间,但主体别变”

- “左右两边都补出更多桌面,整体氛围保持不变”

在这种任务里,对话式编辑通常比手工抠遮罩更快,因为你不是只在修边,而是在和模型一起商量“这个更大的场景应该长什么样”。

这种逻辑现在也延伸到了 OpenAI 的开发侧工具。当前图像文档明确写着,Responses API 支持多轮图像编辑,并能通过 action 控制是生成还是编辑。这对做“像创意编辑器一样工作”的产品很有价值。

但同一份文档也说得很清楚:GPT Image 的遮罩更像提示词驱动的引导,不是绝对精确的硬边界。所以如果你要的是“主商品一像素都不能乱”的合成级控制,ChatGPT 不是最稳的契约;但如果你要的是“保持这张图的核心,同时把场景扩得更自然、更完整”,它非常强。

如果你的更大问题其实是“我日常该长期用哪一种图像生成器”,可以继续看我们的最佳 AI 图像生成器指南。

做自动化时,真正值得看的是 Vertex AI Imagen 和 OpenAI API

一旦你从单次修图走向可重复工作流,判断逻辑会立刻变得更清楚。你不再问“哪张图单独看最惊艳”,而是问“哪种 API 契约最适合我的控制方式”。

Vertex AI Imagen 在“结构化遮罩编辑”这件事上更清晰。Google 当前的编辑文档把 EDIT_MODE_BGSWAP 和 EDIT_MODE_OUTPAINT 的区别写得非常明确,而且这不是纸面概念。BGSWAP 是在遮罩区域里补背景,同时保留未遮罩区域中的主体内容,所以 Google 才会说它很适合商品编辑。OUTPAINT 则是把图片往遮罩区域继续延展,还能补完贴着边界的部分物体。Google 还建议 outpaint 场景把 mask_dilation 控在 0.01 到 0.03 之间,并强调提示词应该描述“缺失区域该长什么样”,而不是只写一个单词。

这就是很典型的生产级契约。它不仅告诉你能做什么,还告诉你系统是怎么想的。

OpenAI 的 API 则更灵活,也更像创意编辑器。你可以通过多轮对话不断迭代同一张图,还能在需要时强制进入编辑模式。但它同样明确提醒:遮罩是引导,不是绝对模板。实际效果上,这让它更适合创意型扩景,而不是那种“英雄商品绝对不能被碰”的刚性任务。

最简单的判断方式如下:

| 如果你需要 | 更合适的路线 | 原因 |

|---|---|---|

| 保护商品主体,只把背景往外扩 | Vertex AI Imagen | 遮罩式编辑模式明确,背景与 outpaint 的区别清楚 |

| 做一个可以多轮对话迭代的图像编辑器 | OpenAI Responses API | 多轮编辑自然,适合连续改图 |

| 先快速试创意,再进严格修图 | OpenAI + Photoshop / Vertex | 先用聊天式外扩找方向,再进保真工具收口 |

如果你的真实任务更接近换背景、清背景,而不是延展画面,可以继续看我们的 Gemini 图片背景修改指南。

怎样才能让 AI 扩图更干净

多数难看的 AI 扩图其实不是随机翻车,而是固定错误反复出现。

先把画布扩少一点。

你一次要求模型补得越多,它越容易从“续画面”滑向“重写整张图”。在很多真实场景里,只多出 15% 到 25% 的边界,就足够解决版位问题。

先做连续性,再做创意。

这也是 Photoshop 空提示词策略特别有价值的原因。先让模型把原图顺下来,再在第二轮去要风格、道具或更明显的构图变化。如果你把“变宽”和“顺便把场景也重做一遍”塞进同一轮,最容易出现主体漂移。

保护你最在意的边缘。

只要人物脸部、商品轮廓、或者任何贴着边界的关键物体存在,优先用带选区或遮罩能力的工具。而且保护边界不要抠得过于死板。就连 Google 自己的 Imagen 文档也建议 outpaint 适度扩张 mask。现实里,略宽松一点的保护范围,往往比刀切一样的边界更容易融合自然。

不要把 AI 扩图当成文字修复工具。

可读文字、Logo、包装文案、UI 截图、信息图里的精确标注,仍然是生成式外扩最容易穿帮的地方。正确做法通常是:先把场景扩出来,再回到设计工具或照片编辑器里修关键文字和几何细节。

任务变了,就换工具。

快速改比例先用一键 uncrop。重视连续性时转去 Photoshop。要创意外扩时用 ChatGPT。要规模化或可重复时再进 Vertex 或 OpenAI API。最好的工作流,常常不是一个工具,而是一次正确的工具交接。

今天到底该先开哪个工具?

如果你只是想让图片适配新的比例,先开 Clipdrop Uncrop 这类专用工具。

如果原图很重要,你承受不了奇怪的肩膀、断裂的边缘、或者被编错的商品轮廓,先开 Photoshop。

如果你想让模型和你一起把更大的场景“聊出来”,先开 ChatGPT Images。

如果你真正需要的是一个系统,而不是一次会话,那就根据你的工作流是“遮罩刚性优先”还是“对话迭代优先”,去选 Vertex AI Imagen 或 OpenAI 图像 API。

这才是“AI 扩图”的真实答案。不是一个万能冠军,而是一套更合适的工作流选择。

常见问题

“AI 扩图”到底是什么意思?

通常指的是用生成式 outpainting 在原始画框之外补出新内容,而不是把已有像素硬拉伸。有些工具叫 uncrop,有些叫 generative expand,也有些把它做成遮罩编辑模式。

对大多数人来说,最快的选择是什么?

如果你真实的问题只是比例不合适,专门的 uncrop 工具最快;如果你的真实问题是“保持这张照片可信,同时多出一点空间”,Photoshop 通常更稳。

商品图最适合用什么?

Photoshop 或 Vertex AI Imagen。商品图对边缘错误容忍度很低,这两条路线都更适合保真优先的任务。

uncrop 和 outpaint 有区别吗?

通常有。uncrop 更像快速改画幅;outpaint 更像在原图边界之外继续生成内容,通常控制更强,也更常配合遮罩。

做图片外扩时,Vertex 和 OpenAI API 该选谁?

如果你要明确的遮罩编辑模式和更结构化的生产工作流,选 Vertex;如果你更重视对话式、多轮次的创意编辑循环,选 OpenAI。

为什么 AI 扩出来的边缘会很怪?

通常是因为一次扩得太多、提示词同时改了构图和主体,或者使用的工具精度不适合你最在意的边界。