Que GPT-5 diga GPT-4 no significa por si solo que ChatGPT haya vuelto realmente a GPT-4. OpenAI ahora lo explica de forma bastante directa: la auto-referencia dentro de una respuesta es texto generado y puede ser incorrecta o demasiado generica. Si al mismo tiempo la interfaz muestra una nota como Used GPT-5, OpenAI dice que esa anotacion es la fuente de verdad para ese mensaje, no la frase donde el asistente se describe a si mismo.

Esta confusion aparece mas hoy porque ChatGPT ya no funciona como la vieja idea de "un chat, una etiqueta fija". El selector superior muestra el modelo por defecto del chat, un mensaje concreto puede enrutarse a otro modelo, una conversacion antigua puede continuar en un equivalente nuevo despues de una retirada de modelos, y un Custom GPT o unas instrucciones viejas pueden seguir empujando texto heredado de GPT-4. Cuando esas capas no coinciden, la linea donde el asistente dice quien es suele ser la senal mas debil de todas.

Este articulo fue verificado con paginas actuales del Help Center de OpenAI, las ChatGPT Release Notes, el GPT-5 System Card y la documentacion actual para desarrolladores de OpenAI el 1 de abril de 2026.

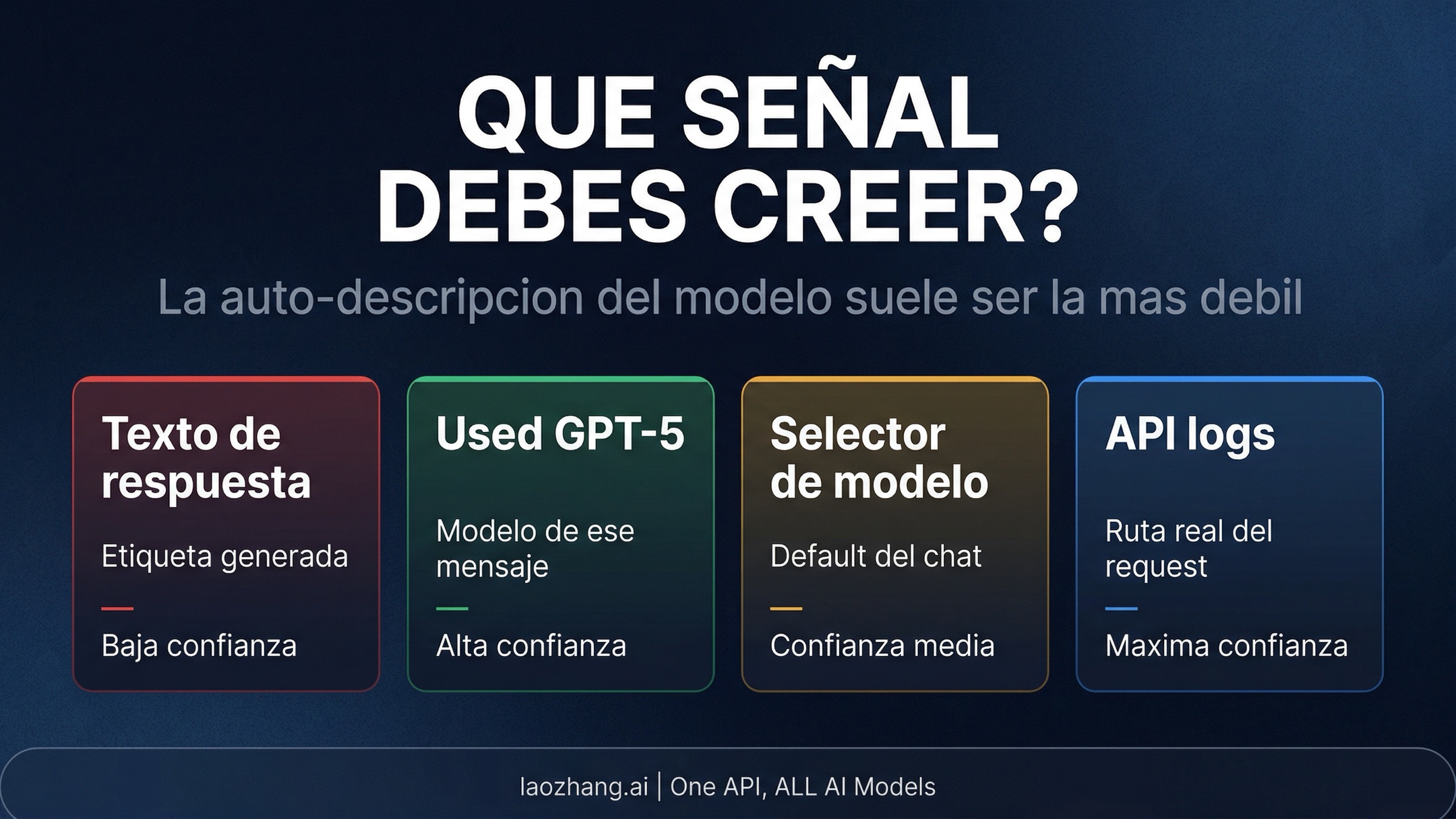

Respuesta rapida: que senal debes creer

Empieza por esta jerarquia:

| Senal | Lo que realmente indica | Nivel de confianza | Cuando usarla |

|---|---|---|---|

| El asistente dice "soy GPT-4" | Auto-descripcion dentro del texto generado | Baja | Sirve como pista, no como prueba |

Used GPT-5 o nota parecida | Que modelo manejo ese mensaje concreto | Alta | En ChatGPT, mira esto primero |

| El selector de modelo | El modelo por defecto del chat | Media | Util para el default del chat, no siempre para un mensaje concreto |

| El request y los logs del API | El modelo que tu app llamo de verdad | La mas alta en API | En integraciones y debugging, usa esto |

La correccion central es sencilla. En ChatGPT, OpenAI trata la anotacion por mensaje como authoritative y la auto-referencia dentro de la respuesta como texto fallible. En el API, la fuente fuerte son tus requests y tus logs. El modelo puede describirse mal si el prompt, el estado de la conversacion o una instruccion heredada lo empujan en esa direccion.

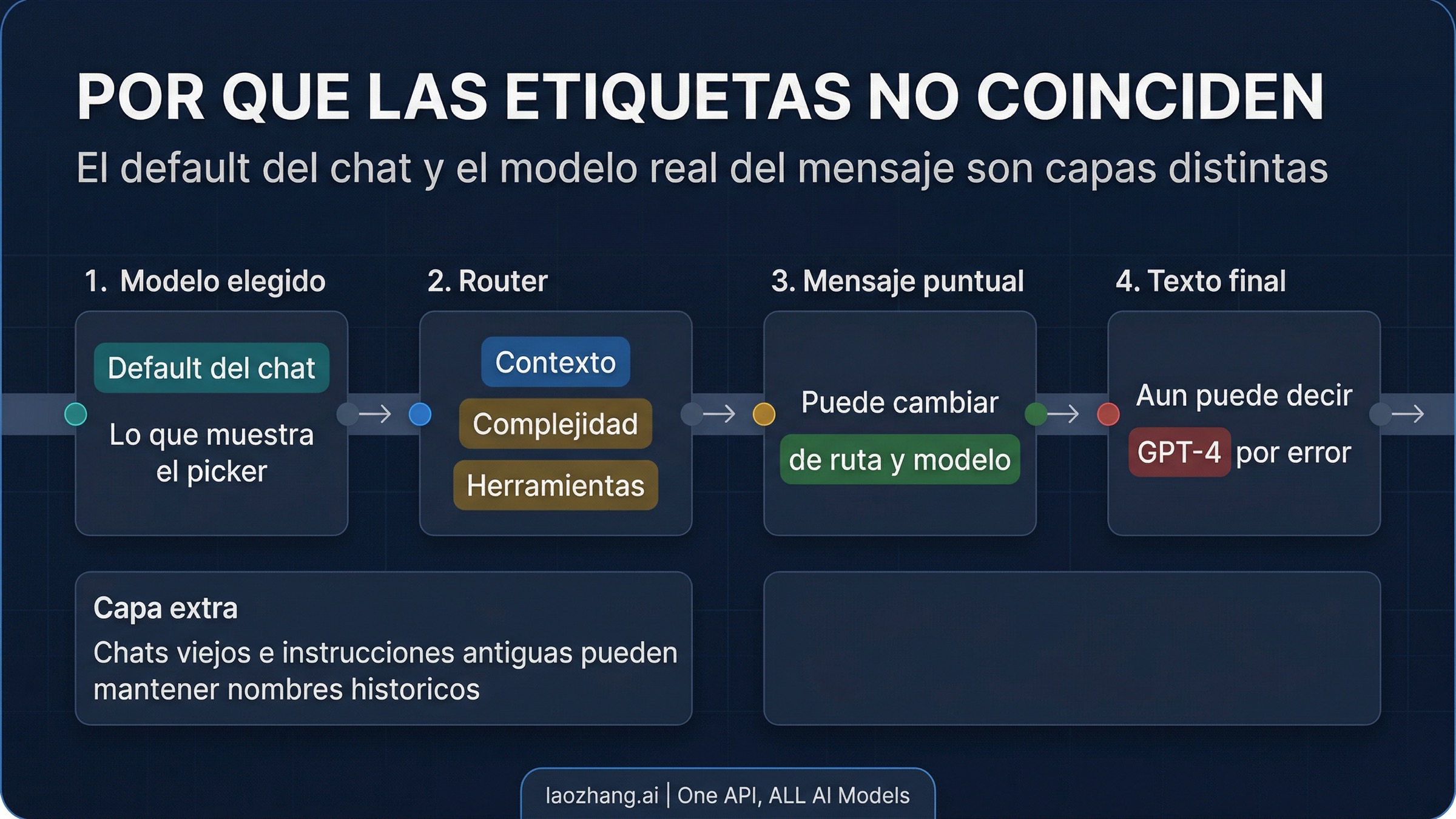

Por que esto pasa mas ahora: GPT-5 en ChatGPT es un sistema enrutado

El propio lenguaje oficial de OpenAI explica gran parte del problema. El GPT-5 System Card describe GPT-5 como un sistema unificado con un router en tiempo real que decide que ruta de modelo usar segun el contexto, la complejidad, la necesidad de herramientas y la intencion explicita. Las release notes de ChatGPT tambien presentaron GPT-5 como un sistema con auto-switching, y mas tarde mostraron de forma mas visible controles como Instant, Thinking y el acceso a modelos legacy.

Eso significa que "el modelo" en ChatGPT ahora vive en varias capas. Una es el modelo por defecto que elegiste para el chat. Otra es el modelo que manejo un mensaje concreto. Otra es el equivalente actual de una conversacion antigua tras la retirada de modelos anteriores. Y otra es el texto que el asistente genera cuando habla de si mismo. Muchas veces estas capas coinciden. Pero cuando no lo hacen, el usuario ve una contradiccion de nombres y la interpreta como si fuera una caida de modelo.

La pagina de ayuda sobre Used GPT-5 lo deja aun mas claro. OpenAI dice que algunos prompts pueden enrutarse a otro modelo a nivel de mensaje, mientras que el modelo que elegiste sigue siendo el default del chat. En otras palabras, la etiqueta del picker y el modelo real de una respuesta concreta pueden diferir temporalmente sin que todo el chat haya cambiado de modelo.

Por eso puedes ver a la vez estas tres cosas:

- el picker sigue mostrando tu modelo por defecto

- una respuesta concreta muestra

Used GPT-5 - el texto de la respuesta aun dice "como modelo GPT-4"

No son necesariamente tres afirmaciones incompatibles. Son tres capas distintas, y la mas debil de ellas es la auto-descripcion dentro del texto.

Las tres causas mas comunes

La mayoria de los casos reales encaja en una de estas tres bolsas. La manera de arreglarlo depende de cual sea la tuya.

1. Un mensaje concreto fue enrutado a otro modelo. Este es el caso mas explicitamente documentado por OpenAI. La ayuda dice que el sistema puede enrutar mensajes individuales a otro modelo. El ejemplo publico mas claro es el manejo de temas sensibles, pero el System Card deja ver un marco mas amplio: importan el contexto, la complejidad y la necesidad de herramientas. Si la interfaz te dice Used GPT-5, esa es una senal mas fuerte que la frase dentro de la respuesta.

2. Estas dentro de un chat antiguo o de una superficie legacy que fue migrada hacia adelante. OpenAI retiro varios modelos antiguos de ChatGPT en 2026 y llevo conversaciones existentes a equivalentes nuevos. Las release notes dicen que las conversaciones que usaban GPT-5.1 pasan automaticamente a GPT-5.3 Instant o a equivalentes de GPT-5.4 Thinking / Pro. La nota de retirada de GPT-4o y otros modelos tambien dice que conversations y projects pasan a equivalentes de GPT-5.3 Instant y GPT-5.4. Eso importa porque el historial del hilo puede quedarse atras respecto al backend actual.

3. Siguen vivas instrucciones viejas que dicen GPT-4. OpenAI no publica una ayuda dedicada que diga "por esto GPT-5 sigue diciendo GPT-4", asi que esta parte debe presentarse de forma honesta como una inferencia, no como una cita literal oficial. Pero es una inferencia fuerte y util. OpenAI dice que personality y custom instructions ahora se aplican de inmediato a todos los chats. Y la guia de prompting de GPT-5 dice que GPT-5 sigue las instrucciones con mucha precision y puede verse especialmente afectado por instrucciones vagas o contradictorias. Si juntas esas dos piezas, aparece una explicacion muy practica: si en tu builder prompt, en tu system prompt, en tus plantillas guardadas o en tus custom instructions aun queda You are GPT-4 o un texto equivalente, GPT-5 puede seguir soltando ese nombre aunque el backend real ya sea otro.

Y esta tercera bolsa es la que suele hacer que el problema parezca persistente. El enrutamiento de un mensaje suele ser puntual. La migracion de un chat viejo se explica con fechas y release notes. Pero un prompt viejo vuelve a meter el nombre anterior cada vez hasta que lo limpias.

Como verificar que modelo respondio de verdad

El metodo correcto depende de la superficie.

En ChatGPT, empieza por lo que OpenAI dice que debes tomar como authoritative. Si la respuesta muestra una nota tipo Used GPT-5, tomala como la fuente de verdad para ese mensaje. Despues mira el picker, que si te sirve para saber el default del chat, pero no necesariamente para certificar cada respuesta individual.

Si estas dentro de un hilo antiguo, no saques conclusiones solo por memoria de como estaba configurado antes. Revisa primero las release notes y los avisos de retirement. OpenAI ya documento que conversaciones antiguas continúan sobre equivalentes actuales.

Si usas un Custom GPT, lo importante es revisar la configuracion del builder y el texto de instrucciones, no seguir preguntandole al modelo "quien eres". El valor de esa auto-descripcion es bajo. El valor del texto real del prompt es mucho mas alto.

Para el API, la separacion debe ser aun mas estricta. No copies sin mas la intuicion de ChatGPT. El enrutamiento por mensaje pertenece a la experiencia del producto ChatGPT. En el API, la fuente fuerte es tu request y tus logs. Si tu aplicacion envio GPT-5 y la respuesta dijo "soy GPT-4", eso suele decir mas sobre tu prompt u output que sobre una sustitucion secreta del backend.

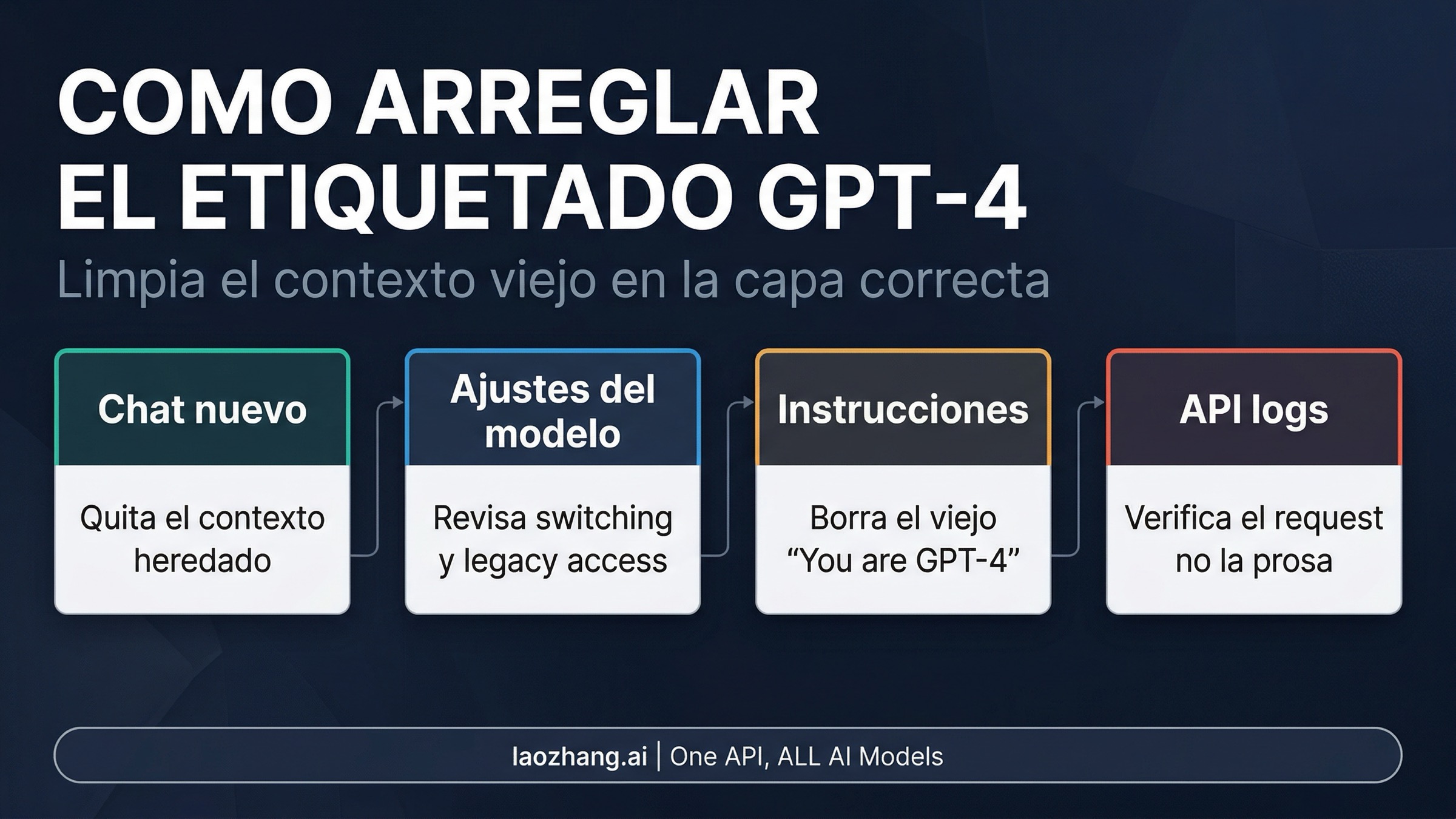

Como arreglarlo si el nombre equivocado sigue apareciendo

Una vez que entiendes en que capa esta el problema, el camino de reparacion es corto.

- Abre un chat nuevo para probar. Los hilos viejos arrastran demasiado ruido: contexto heredado, cambios previos, instrucciones antiguas y habitos de salida.

- Revisa los ajustes del modelo y el acceso a legacy models. No son un problema por si mismos, pero hacen mas facil confundir el default del chat con el modelo real de una respuesta concreta.

- Audita las instrucciones de tu Custom GPT, tus custom instructions y tus plantillas de prompt persistentes. Busca

You are GPT-4,As GPT-4y cualquier texto antiguo de identidad. Cuando el error aparece de forma estable, muchas veces la causa esta ahi. - En API, mira los logs y no la prosa. Para regression testing, verificacion de despliegues y comparativas, pedirle al modelo que se describa no es un metodo fiable.

Hay un habito que conviene abandonar cuanto antes: usar la pregunta "dime que modelo eres" como paso de verificacion. En el ChatGPT actual, con su pila enrutada, es un metodo debil. En debugging de API, directamente es una mala costumbre.

Entonces, significa que de verdad estas usando GPT-4?

Normalmente no. Al menos, no puedes concluirlo solo por esa frase.

Si la unica "prueba" que tienes es que la respuesta escribio GPT-4, eso es evidencia debil. OpenAI reconoce que esas auto-referencias pueden ser incorrectas o genericas. En cambio, si la UI muestra Used GPT-5, esa es una senal bastante mas fuerte. Si los logs del API muestran un request a GPT-5, eso tambien pesa mas que la prosa del modelo.

El problema se vuelve verdaderamente importante cuando el nombre incorrecto coincide con senales mas fuertes: por ejemplo, si en el builder queda texto viejo de GPT-4, si realmente elegiste una superficie legacy o si los logs muestran un model path distinto del que esperabas. Solo ahi deja de ser un simple desajuste de wording y pasa a ser un problema de configuracion o de superficie de producto.

La regla mas util

Cuando GPT-5 diga GPT-4, asume primero que la frase esta mal antes de asumir que el backend esta mal.

Despues revisa la senal mas fuerte para esa superficie: anotaciones y settings en ChatGPT, request y logs en API, builder e instrucciones en Custom GPT. Asi la confusion de nombres deja de ser un misterio y se convierte en un diagnostico corto y manejable.